Jake Sully, główny bohater filmu Jamesa Camerona pt. Avatar, jest sparaliżowany od pasa w dół. Otrzymuje on szansę uczestniczenia w wojskowym projekcie prowadzonym na odległym księżycu układu Alfa Centauri. Zgodziwszy się zwrócona zostaje mu utracona sprawność fizyczna, lecz tylko poprzez akt wcielenia się w ciało obcego, rdzennego mieszkańca. Jake, leżąc w kapsule, potrafi poruszać błękitnym stworzeniem, widzi, słyszy i czuje to co ono. Taka technologia uczyniłaby wielu ludzi bardzo szczęśliwymi i na teraźniejszej Ziemi. Na razie osoby, które chcą dzięki nowoczesnej nauce odzyskać skradzione przez los czy chorobę czucie muszą godzić się na poważne wyrzeczenia względem swojego ciała — np. na stałe zespolenie go z maszyną.

Ataksja rdzeniowo-móżdżkowa to grupa chorób o podłożu genetycznym. Osoby nią dotknięte muszą liczyć się ze zmianami w obrębie móżdżku i rdzeniu kręgowym, co najczęściej objawiać się będzie postępującymi zaburzeniami koordynacji ruchowej. Ataksja Jan Scheuermann postępowała bardzo szybko — najpierw nogi odmawiały jej posłuszeństwa, później problem zaczął dotyczyć również i rąk. W końcu na wózek permanentnie usadowiła ją tetraplegia, paraliż czterokończynowy. Kobieta, mimo przeszkód, szukała pomocy i nie tracąc nadziei zgłosiła się jako ochotnik do programu Pitt School of Medicine. Tam nakarmili ją czekoladą.

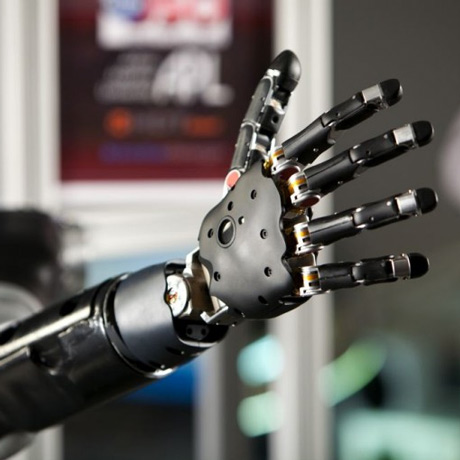

Neuronaukowcy zajmujący się przypadkiem kobiety zaprojektowali dla Jan interface mózg — komputer (BCI) składający się z dwóch płytek zakończonych 96 elektrodami. Połączyli je z korą ruchową pacjentki podczas skomplikowanej operacji. Pierwsza płytka odczytuje aktywność rejonu mózgu, który rozświetlał się gdy Scheuermann myślała o poruszaniu dłonią, druga sprawdza miejsce aktywowane gdy poruszone miało być ramię. Komputer uczył się interpretować wzory aktywizacji elektrod, pacjentka uczyła się dawać mu jednoznaczne sygnały. Po tygodniu mogła już niemrawo poruszać ramieniem robota przytwierdzonym do jej łóżka. Po roku jest w stanie nakarmić się sama tabliczką czekolady. Musi się czuć niesamowicie odzyskawszy chociaż część kontroli, którą kiedyś straciła wydawałoby się bezpowrotnie. Metoda zastosowana w tym przypadku jest jednak mocno inwazyjna. Czy istnieje jakiś sposób, by sterować robotem bez kłopotania sztabu lekarzy i chirurgów? Niejeden.

Naukowcy z CNRS-AIST Joint Robotics Laboratory współpracując z ludźmi CNRS-LIRMM Interactive Digital Human group zamiast umieszczać elektrody w korze ruchowej ochotników umieścili je na czepku, który, w odróżnieniu od poprzednio omawianej metody, można zdjąć nie narażając się na trwałe uszkodzenie mózgu. Jest to, przyznacie, dość duży plus tej techniki. Osoba, która pragnie zostać żywym kontrolerem, zakłada ów materiałowy hełm i siada przed ekranem komputera. W centralnym punkcie monitora widać obraz z kamery umieszczonej w głowie robota. Prócz tego użytkownikowi wyświetlają się symbole powiązane z akcją, którą ma wykonać robot.

Bardzo ciekawy jest pomysł na interpretację sygnałów płynących z mózgu partycypantów. Symbole migają bowiem z różną częstotliwością. Elektrody starają się interpretować stan skupienia uwagi na którymś elemencie właśnie poprzez badanie jaką częstotliwość obserwuje gałka oczna (Metoda SSVEP). Otrzymawszy informacje o skupieniu uwagi komputer przesyła do maszyny odpowiednie komendy. Ta grzecznie, lecz powoli, wykonuje rozkazy człowieka. (Przynajmniej do czasu buntu robotów…)

Na górze sam robot. Na dole obraz widziany przez ochotników – w środku świat oczami Spykee

Holendrzy, jak to zwykle Holendrzy, posunęli się jeszcze dalej. Najpierw zakupili Spykee, robota wyposażonego w kamerę, którym można kierować za pośrednictwem sieci WiFi. Jest to zabawka, lecz w zamyśle autorów idealnie nadawała się do zadania, które chcieli przed nią postawić.

Ochotnicy, którzy chcieli pojeździć gąsienicami mechanicznego szpiega kierowani byli do skanera fMRI. W tubie, zazwyczaj pustej, tym razem znajdował się ekran na którym pokazywano obraz z kamery robota wraz z trzema strzałkami. Partycypanci mieli chwilę czasu na potrenowanie skupienia uwagi na symbolach, a komputer miał chwilę czasu na poznanie charakterystycznej dla każdej strzałki aktywizacji kory mózgowej. Do nauki algorytm zbierał dane techniką opierającą się na sprawdzaniu poziomu utlenienia krwi karmiącej neurony (BOLD) i już po chwili mały robocik zasuwał po laboratorium zasilany tylko baterią i przekazywanymi przez WiFi ludzkimi myślami.

Problemem może być wielkość maszyny – nie oszukujmy się, każdy z nas marzy o bardziej mobilnym kontrolerze niż zajmujący pół pokoju buczący jak jasna cholera skaner. Tutaj idealnie nadawałby się czepek, jednak w jego wypadku problemem może być jakość zbieranych informacji, czułość elektrod. Lecz nie tylko dane zbierane z EEG są niedokładne.

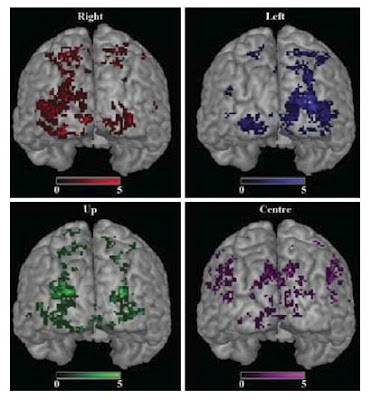

Aktywizacja związana ze skupieniem uwagi na poszczególnych strzałkach

Problemem są też wyniki fMRI, chociaż kłopot jest tutaj innego rodzaju. Nie do końca bowiem wiadomo co tak naprawdę widoczna aktywizacja pokazuje. Autorzy publikacji zwracają na to uwagę mówiąc, że widoczne poniżej rozświetlenie kory może pokazywać tylko ruch, nawet nieświadomy, gałek ocznych, w kierunku strzałek. Byłaby to wielka szkoda, ponieważ wtedy cały eksperyment straciłby dużo ze swojej niesamowitości. Budujące jest jednak różne podejście do kontroli mechanicznych pomagierów. Wszystkie wykorzystywane technologie będą się rozwijać – co więcej mogą w którymś punkcie przeciąć swoje drogi i być wspólnie wykorzystywane by jeszcze lepiej zbierać dane z ludzkich głów.

Nie można być również ślepym na fakt, że ochotnicy ostatniego eksperymentu mogli się poczuć jak w pierwszej, bardzo wczesnej wersji projektu Avatar. Fabuła tego filmu dzieje się w 2154 roku. Aż strach pomyśleć co wymyślimy do tego czasu.

Andersson, P., Pluim, J., Viergever, M., & Ramsey, N. (2012). Navigation of a Telepresence Robot via Covert Visuospatial Attention and Real-Time fMRI Brain Topography DOI: 10.1007/s10548-012-0252-z

Collinger, J., Wodlinger, B., Downey, J., Wang, W., Tyler-Kabara, E., Weber, D., McMorland, A., Velliste, M., Boninger, M., & Schwartz, A. (2012). High-performance neuroprosthetic control by an individual with tetraplegia The Lancet DOI: 10.1016/S0140-6736(12)61816-9

Fakt, można myśleć optymistycznej o przyszłości, ale także można zacząć się tej technologii bać…

Racja. Ale o tym za dwa wpisy ;)

W sumie to fajna sprawa… Taka ręka się nie meczy :D

Pytanie tylko kiedy przeniosą mózg starca do maszyny aby dać my kolejne życie. Tak naprawdę jedyne co by brakowało to hormonów. Co to za życie bez fenyloetyloaminy:/ To pewnie też rozwiążą:)

Interesujące, choć nie do końca jasne